AI real-time music make proposed by

Prof.Satoshi Nishimura

E-mail:

If interested (snishi-tky(a-mark)ninus.ocn.ne.jp )

Back to top

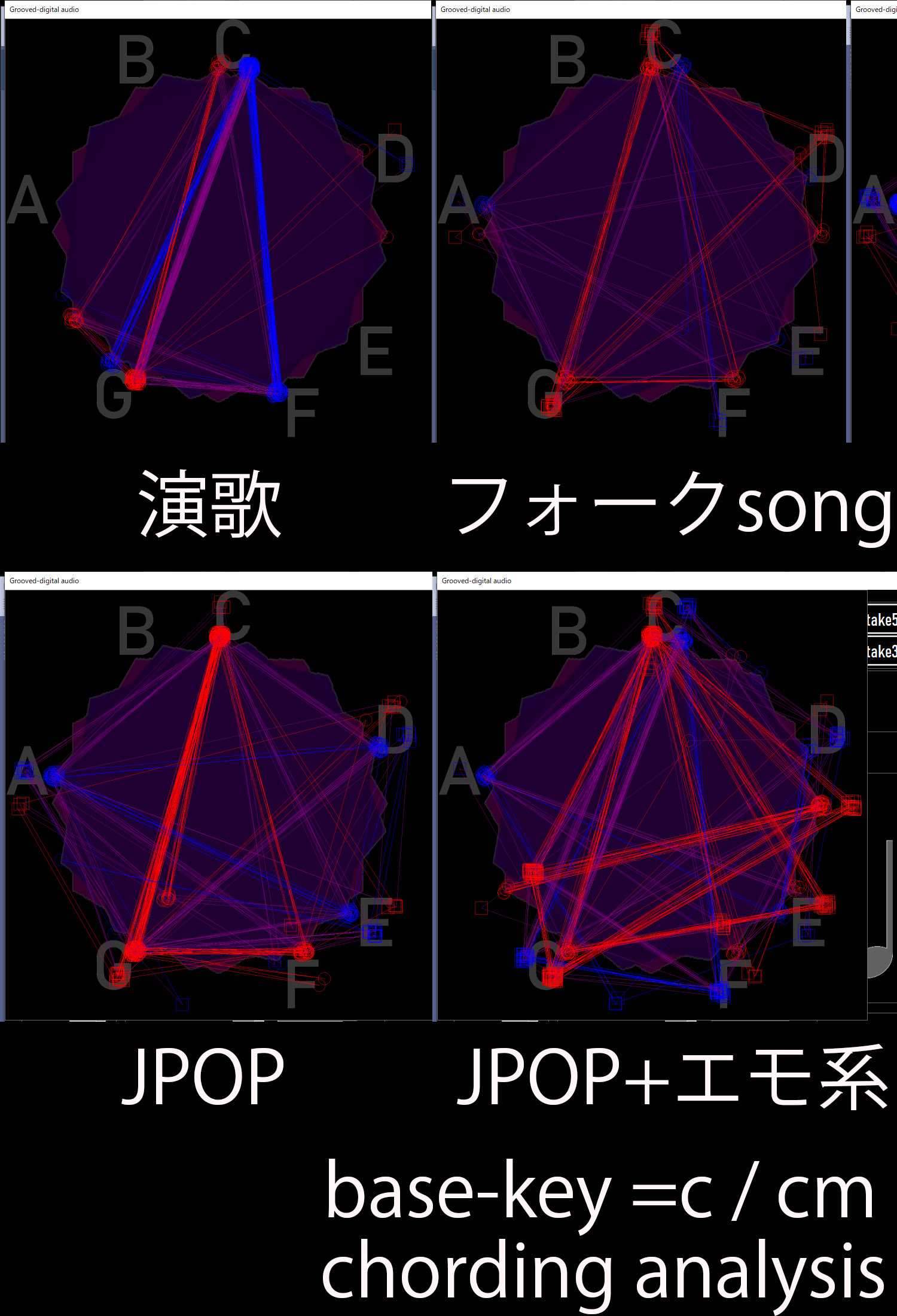

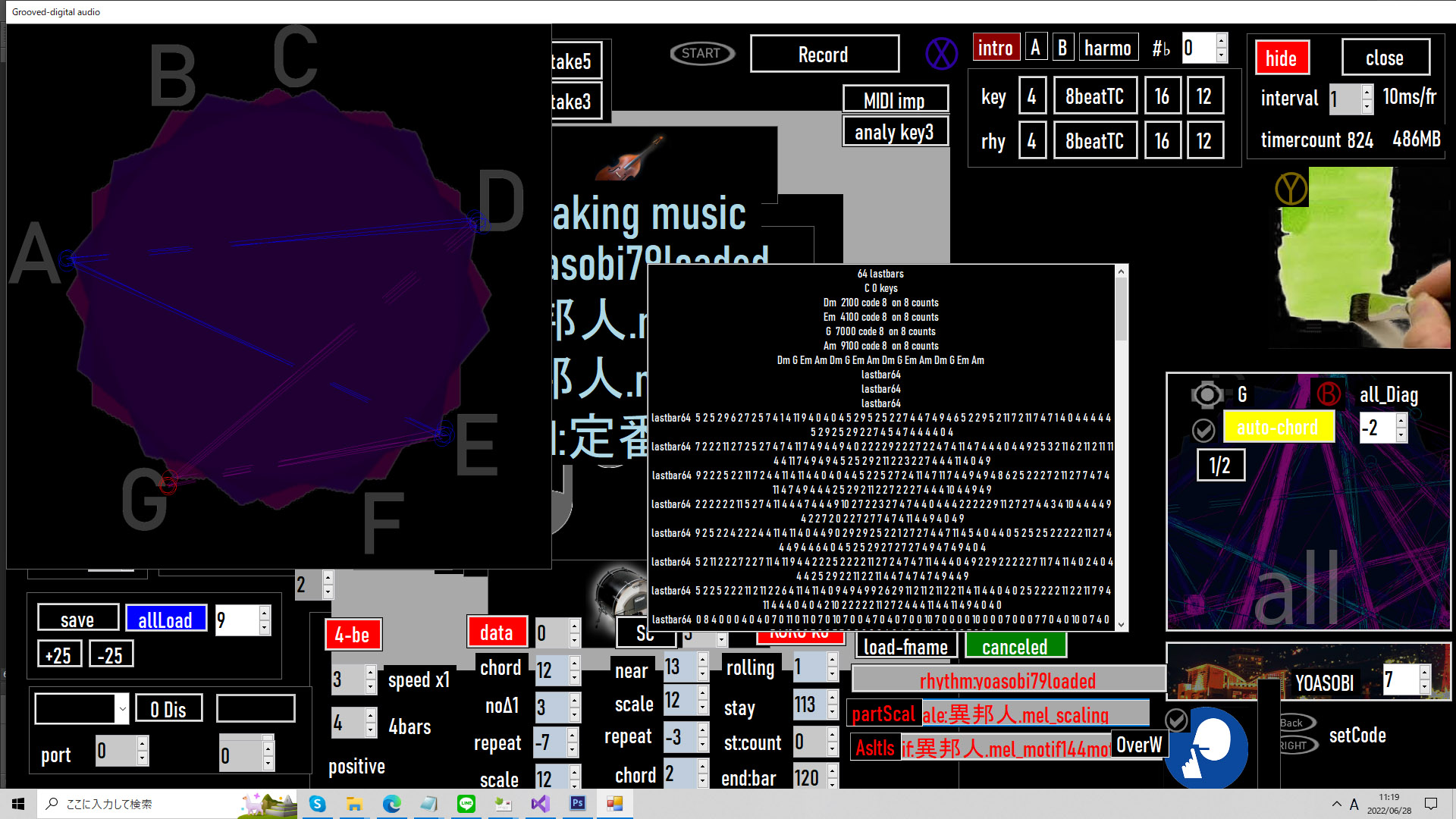

双方向性作曲AI「奏でるくん」 real time music make

1・ライブラリ学習と理論 library and theory

音楽のおける「気持ちよさ」は数学的に解きづらい。理論も曖昧。

2・双方向性 interactive

聞いてる人が「アリ」「ナシ」を入力しながら、音楽をリアルタイムで合成すれば

より面白いものがつくれるはず

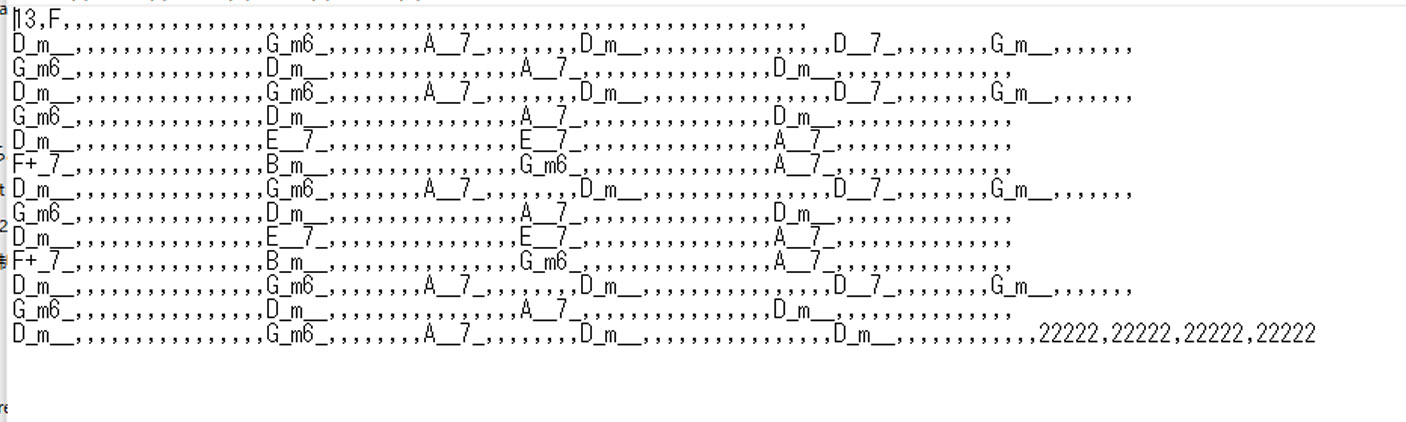

3・既存の曲やその場演奏をライブラリ化 library from any data

データをどんどんライブラリに組み込んでいく。簡単に。

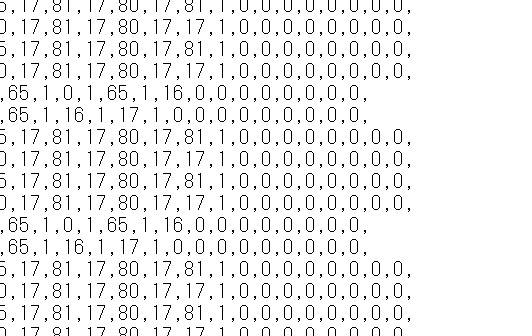

生成アルゴリズム algorhythm

既存曲から、

1・スケール scaling

を分離しライブラリ化する。

鍵盤をつかわないでジョイスティックボタンでも曲がつくれる

Movie:

how it runs

Movie:

how it runs

Movie:

how it runs

Movie:

how it runs

Back to top

4・リズムパターン rhythm pattern

4・リズムパターン rhythm pattern